ENQUÊTE - Plus de 5 200 publications haineuses recensées en un mois : le premier état des lieux massif de la haine anti-maghrébine sur X

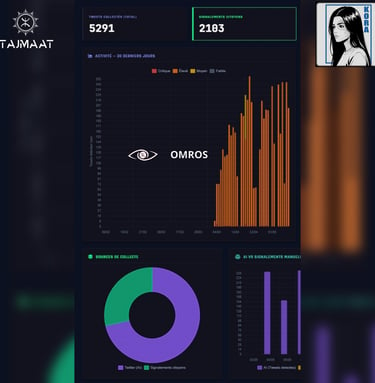

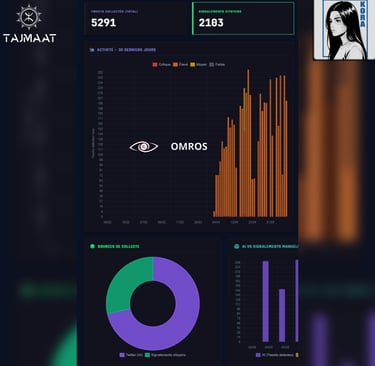

Grâce à KORA, notre agent d’intelligence artificielle développé pour OMROS, plus de 5 200 publications et 4 500 profils ont été documentés en seulement trente jours. Un niveau inédit de documentation qui met en lumière l’ampleur d’une haine anti-maghrébine largement sous-estimée.

ACTUALITÉSENQUÊTE

Pendant plusieurs années, l’ampleur réelle des discours haineux visant les Maghrébins sur les réseaux sociaux est restée difficile à mesurer. Entre suppressions rapides de publications, multiplicité des comptes anonymes et incapacité des outils traditionnels à suivre le rythme des plateformes, aucun état des lieux précis n’avait jusqu’ici pu être établi à grande échelle.

Après un mois de phase pilote, notre Observatoire Maghrébin de Recoupement et d’Orientation des Signalements (OMROS), à travers son agent IA KORA, publie aujourd’hui un premier bilan particulièrement préoccupant.

En seulement trente jours de surveillance sur X, plus de :

5 200 publications haineuses recensées

4 500 profils documentés dans le “Nexus”

30 comptes suspendus à la suite de signalements automatique

Des chiffres qui ne représentent qu’une fraction de la réalité observable sur la plateforme.

Un premier recensement inédit de cette ampleur

Actuellement, il s’agit de la première tentative de documentation quantitative à grande échelle des contenus explicitement hostiles aux Maghrébins sur un réseau social majeur.

L’objectif poursuivi n’était pas uniquement statistique.

Il s’agissait avant tout de répondre à une problématique devenue récurrente : comment documenter un phénomène massif lorsque les contenus sont supprimés, modifiés ou publiés plus rapidement qu’ils ne peuvent être signalés ?

Pour répondre à cette difficulté, KORA, notre agent IA développé pour OMROS, analyse les publications publiques, identifie certains termes hostiles, étudie le contexte conversationnel, recoupe les profils récurrents afin d’établir un niveau de gravité et de priorisation, signale automatiquement les profils recensés.

Le système est notamment capable d’identifier des variantes volontairement déformées de certains termes racistes afin de contourner les filtres traditionnels de modération.

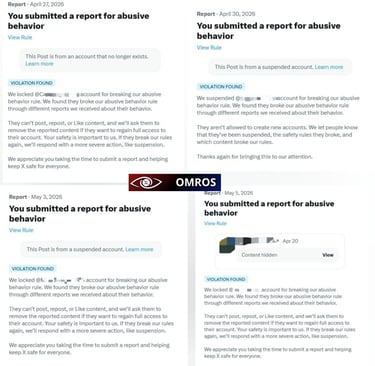

Plus de 3 500 publications autour du terme « bougnoule »

L’un des constats les plus marquants de cette première phase pilote concerne la fréquence d’utilisation d’insultes explicitement racistes visant les Maghrébins.

Parmi les plus de 5 200 publications recensées, 3 556 concernent exclusivement le terme “bougnoule” et ses multiples variantes orthographiques, incluant des formulations volontairement altérées ou codées.

KORA indique avoir recensé de nombreuses déclinaisons destinées à contourner les systèmes classiques de modération, parmi lesquelles :

fautes volontaires ;

substitutions de lettres ;

orthographes phonétiques ;

déformations lexicales.

Le terme « bogmoules », régulièrement employé comme insulte ciblant les Maghrébins, figure également parmi les expressions les plus détectées.

Autre donnée préoccupante : 485 publications concernent spécifiquement le terme “bicot”

Un mot historiquement associé à un vocabulaire raciste, toujours largement utilisé sur les réseaux sociaux malgré les politiques de modération affichées par les plateformes.

Pour nous, ces chiffres témoignent d’un phénomène dépassant largement des cas isolés. Nous estimons que lorsque plusieurs milliers de publications utilisant des insultes raciales explicites peuvent être recensées en seulement un mois, nous ne sommes plus face à quelques dérapages ponctuels, mais face à une réalité structurelle.

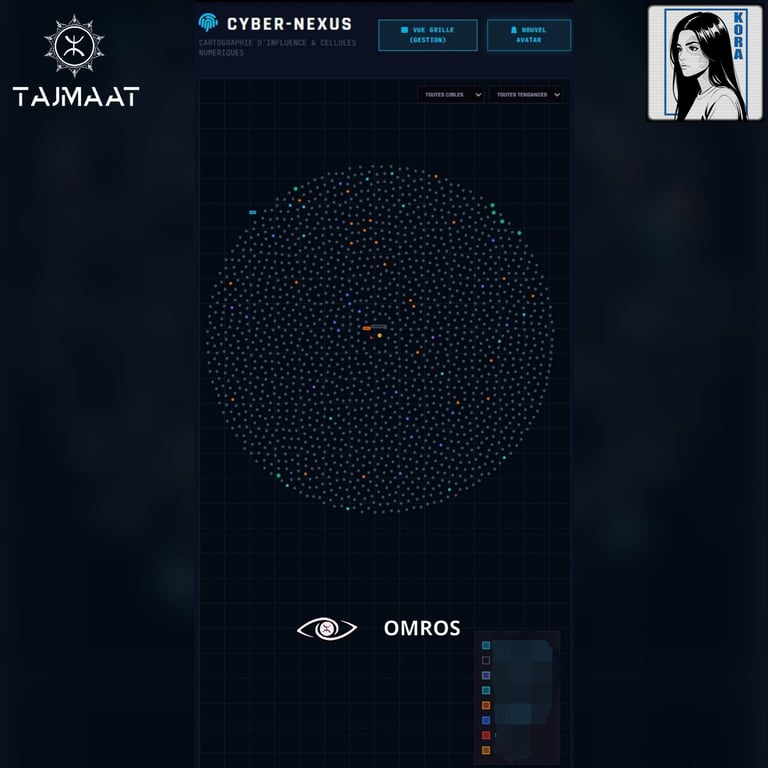

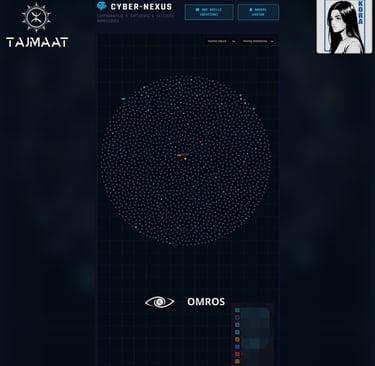

4 500 profils recensés dans le Nexus KORA

Au-delà des publications, nous avons documentés plus de 4 500 profils dans le “Nexus” de KORA, une mémoire analytique permettant de contextualiser les dynamiques observées, dont chaque point représente un internaute recensé.

L’objectif n’est pas uniquement de signaler des contenus isolés, le système vise également à :

repérer des récidives ;

comprendre certaines dynamiques collectives ;

identifier des comportements récurrents ;

améliorer la priorisation des signalements.

Cette logique permet notamment de distinguer un contenu isolé d’un comportement durable ou répétitif.

Selon les premiers résultats, certains comptes reviennent de manière récurrente dans des interactions ou publications visant spécifiquement les populations maghrébines.

Une modération insuffisante sur X ?

Les résultats de cette phase pilote interrogent également sur l’efficacité réelle de la modération appliquée par X concernant les discours haineux anti-maghrébins.

Une partie significative des publications recensées demeurait accessible au moment de leur documentation, parfois malgré des formulations explicitement discriminatoires ou des signalements déjà effectués.

Cette situation émet une question centrale, la modération actuelle des plateformes est-elle réellement adaptée au volume et à la sophistication des discours haineux ?

L’utilisation croissante de termes volontairement mal orthographiés, de formulations codées ou de contenus contextuels rend en effet la détection automatisée plus complexe.

À cela s’ajoute un facteur de volumétrie, des milliers de contenus peuvent être publiés chaque semaine, rendant la modération humaine difficile à l’échelle industrielle.

Cette situation renforce la nécessité d’outils spécialisés de documentation, car sans recensement structuré, il est impossible de mesurer l’ampleur réelle du phénomène. Ce travail permet enfin de visualiser ce qui, jusque-là, restait fragmenté ou invisibilisé.

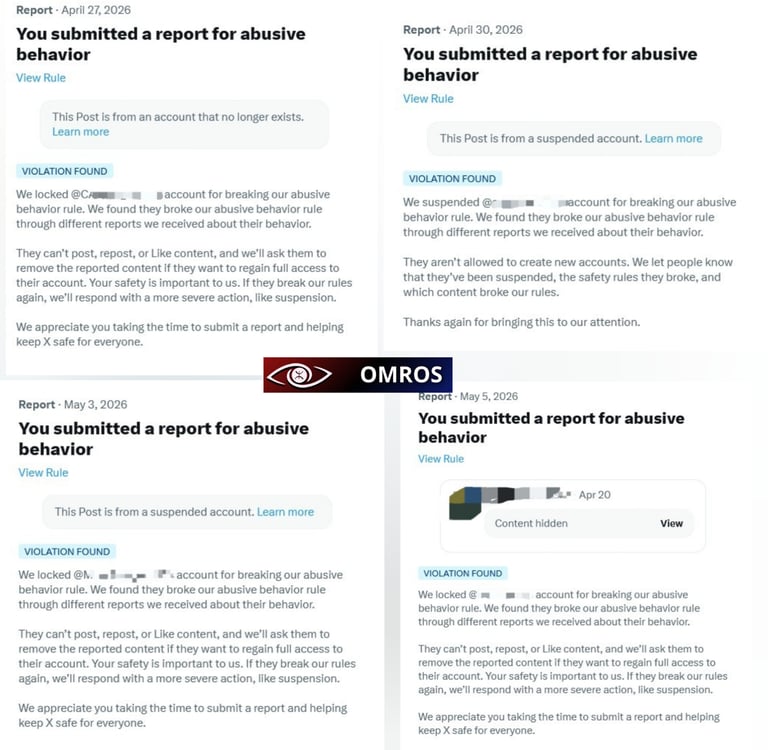

30 comptes déjà suspendus après signalement

Malgré ces limites, 30 comptes ont déjà été suspendus de X à la suite de signalements orientés par KORA.

Ces résultats demeurent encore partiels mais particulièrement très encourageants. KORA étant actuellement en phase de test, les capacités de signalement automatisé ont volontairement été limitées afin d’éviter tout risque d’abus ou d’erreur de ciblage.

La priorité actuelle consiste à consolider les phases d’expérimentation et de calibrage du système, afin de garantir la pertinence des signalements générés automatiquement. À terme, nous estimons que KORA pourrait être en mesure de traiter jusqu’à 500 signalements automatiques quotidiens, sous réserve d’un niveau de précision jugé suffisamment fiable.

Ils permettraient notamment :

une meilleure priorisation

un gain de temps opérationnel

une documentation plus solide avant signalement.

La suspension de certains comptes montre qu’une partie des contenus documentés contrevient effectivement aux règles de la plateforme.

PHAROS : prochaine étape du dispositif

Jusqu’à présent, les signalements vers PHAROS, la plateforme française de signalement des contenus illicites, ont été réalisés de manière ponctuelle.

La phase pilote a néanmoins permis de valider la capacité de KORA à constituer et orienter plusieurs signalements de manière structurée. Certaines limites techniques liées aux interfaces de soumission ont toutefois été identifiées, entraînant ponctuellement des interruptions dans le flux de transmission.

Ces contraintes sont actuellement prises en compte dans les travaux d’optimisation en cours, afin de fluidifier et fiabiliser l’ensemble du processus de signalement.

Plusieurs pistes d’amélioration sont à l’étude pour renforcer l’automatisation de la préparation des dossiers et améliorer la continuité du traitement, avec l’objectif de rendre ce flux pleinement opérationnel et stabilisé au cours du mois de mai.

En bref, l'objectif annoncé est de rendre le traitement et l’orientation des dossiers vers PHAROS totalement actifs au cours du mois de mai, de manière automatique.

À terme, KORA devrait permettre :

une meilleure constitution des dossiers

une meilleure hiérarchisation des cas les plus graves

une accélération des transmissions

une documentation renforcée des contenus sensibles.

Une photographie probablement incomplète du phénomène

Ces chiffres ne doivent pas être interprétés comme une mesure exhaustive, ils constituent plutôt une première photographie partielle d’un phénomène potentiellement bien plus vaste.

Le système n’est actuellement pleinement opérationnel que sur X, tandis que les travaux sur Telegram sont encore en phase de test. TikTok et Facebook restent en développement, notamment afin de permettre l’analyse vidéo et la détection de contenus visant les Maghrébins avant même leur viralité.

Autrement dit, si plus de 5 200 publications haineuses ont déjà été documentées en un seul mois sur une seule plateforme, la volumétrie réelle pourrait être significativement supérieure à l’échelle globale.

Une chose apparaît toutefois clairement à l’issue de cette première phase, la haine anti-maghrébine sur les réseaux sociaux semble bien plus massive, structurée et persistante qu’elle n’apparaît au premier regard.